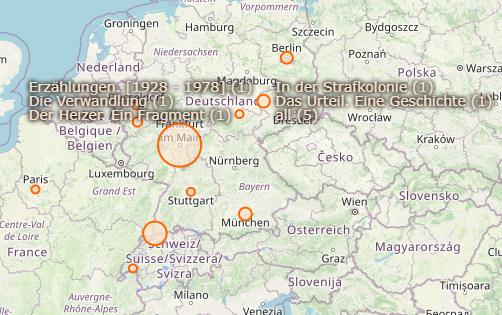

Geobrowser sind Visualisierungstools zur Darstellung von geographischen Punkten oder Routen. In den Geisteswissenschaften können sie unter anderem gewinnbringend für Forschungsfragen eingesetzt werden. Durch die umfassende geographische Visualisierung erschliessen sich oftmals neue Zusammenhänge oder Fragestellungen. So kann man beispielsweise mithilfe eines Textkorpus evaluieren, welche Adjektive gehäuft bei der Beschreibung einer bestimmten Ortschaft vorkommen, oder an welchen Orten die meisten Handschriften gefunden wurden.

Im Folgenden sollen vier webbasierte Tools zur geographischen Visualisierung kurz mit ihren Vor- und Nachteilen vorgestellt werden: DARIAH DE Geobrowser, Palladio, Nodegoat, sowie Google My Maps.